با پیشرفت تکنولوژی و ظهور فناوریهای جدید، حوزه هوش مصنوعی (AI) و یادگیری عمیق (Deep learning) نیز بهسرعت در حال رشد و قویتر شدن است. در این پست به بررسی جدیدترین ترندهای هوش مصنوعی اردیبهشت 1402 می پردازیم.

جدیدترین ترندهای هوش مصنوعی اردیبهشت 1402

۱. یادگیری فدرال (Federated learning)

یادگیری فدرال (یا مشارکتی) یکی از انواع یادگیری ماشین است. این روش به دستگاههای مختلف امکان میدهد بدون اشتراکگذاری دادههای خود در یک سرور مرکزی، بهصورت یک مدل واحد همکاری کنند. این رویکرد بیشتر در موقعیتهایی کاربرد دارد که حفظ حریم خصوصی دادهها مهم است.

برای مثال، گوگل از یادگیری فدرال برای افزایش دقت پیشبینی متنها در کیبورد خود استفاده کرده است (بدون آنکه به حریم خصوصی کاربر لطمه وارد شود). مدلهای یادگیری ماشین معمولا با استفاده از منابع داده متمرکز ساخته میشوند؛ در نتیجه لازم است که دادههای کاربر به یک سرور مرکزی ارسال شود. جمعآوری و ذخیرهسازی دادههای کاربر در یک سرور واحد، باعث نگرانی کاربران و ایجاد مشکلات مربوط به حریم خصوصی میشود.

Federated learning با جلوگیری از ارسال دادهها به یک سرور مرکزی و نگهداری دادهها در دستگاههای کاربران، این مشکل را حل میکند. از آنجایی که مدلهای داده ساختهشده با یادگیری فدرال در دستگاههای کاربران میمانند، دیگر نیازی نیست که حجم وسیعی از دادهها به سرور مرکزی ارسال شوند و این باعث کاهش نیازهای محاسباتی و ذخیرهسازی سیستم میشود.

۲. شبکههای مولد تخاصمی (GANs)

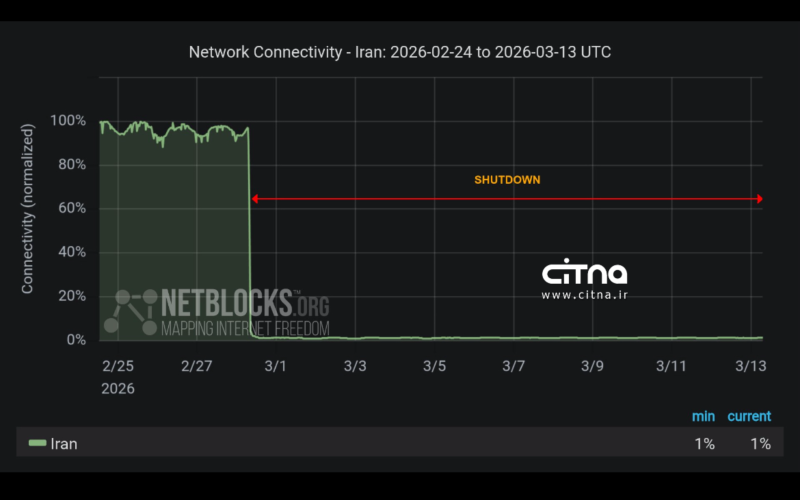

شبکههای مولد تخاصمی (Generated Adversarial Networks) نوعی شبکه عصبی است که با استفاده از آن میتوان دادههای واقعی و جدید (بر اساس دادههای موجود) تولید کرد. مثلا میتوان از این شبکهها برای تولید تصاویر حقیقی انسانها، حیوانات و حتی منظرههای طبیعی استفاده کرد. نحوه کار شبکههای GAN به این صورت است که دو شبکه عصبی را مقابل هم قرار میدهند. یک شبکه دادههای جعلی تولید میکند و شبکه دیگر سعی میکند که فیک یا حقیقی بودن دادهها را تشخیص دهد. به این توییت توجه کنید:

شبکههای مولد تخاصمی یا GANها خیلی زود به یکی از فناوریهای پیشرو در صنعت تولید دادههای واقعی مصنوعی تبدیل شدهاند. شبکههای GAN نوعی شبکه عصبی هستند و از دو شبکه مولد (Generator) و تفکیککننده (Discriminator) تشکیل شدهاند.

۳. هوش مصنوعی قابل توضیح (XAI)

هدف فناوری هوش مصنوعی قابل توضیح (Explainable AI) افزایش شفافیت و درک مدلهای یادگیری ماشین است. وجود XAI اهمیت بسیار زیادی دارد؛ چون باعث میشود که هوش مصنوعی تصمیمهای بیطرف و منصفانه بگیرد. مثال زیر، نمونهای از کاربرد XAI است.

فرض کنید که یک شرکت مالی از الگوریتمهای یادگیری ماشین استفاده میکند تا احتمال نکول وامگیرندهها را حساب کند. اگر از الگوریتمهای جعبه سیاه سنتی استفاده شود، این شرکت یا بانک هیچ اطلاعاتی از فرایند تصمیمگیری الگوریتم نخواهد داشت و نمیتواند این مسئله را به وامگیرنده توضیح دهد. اما با استفاده از XAI، الگوریتم میتواند تصمیمهای خود را توضیح دهد و بانک میتواند بر اساس دلایل منطقی تصمیم بگیرد؛ نه بر اساس اطلاعات نادرست و تبعیضآمیز.

این الگوریتم میتواند مشخص کند که ریسک وامگیرنده را بر اساس معیارهایی مثل امتیاز اعتبار مشتری، درآمد و سابقه پرداختهای او محاسبه شده است. این حد از شفافیت و قابل توضیح بودن، هوش مصنوعی را قابل اعتمادتر و توانایی پاسخگویی آن را بهتر میکند و نهایتا منجر به تصمیمگیری بهتر میشود.

۴. یادگیری تقویتی (Reinforcement learning)

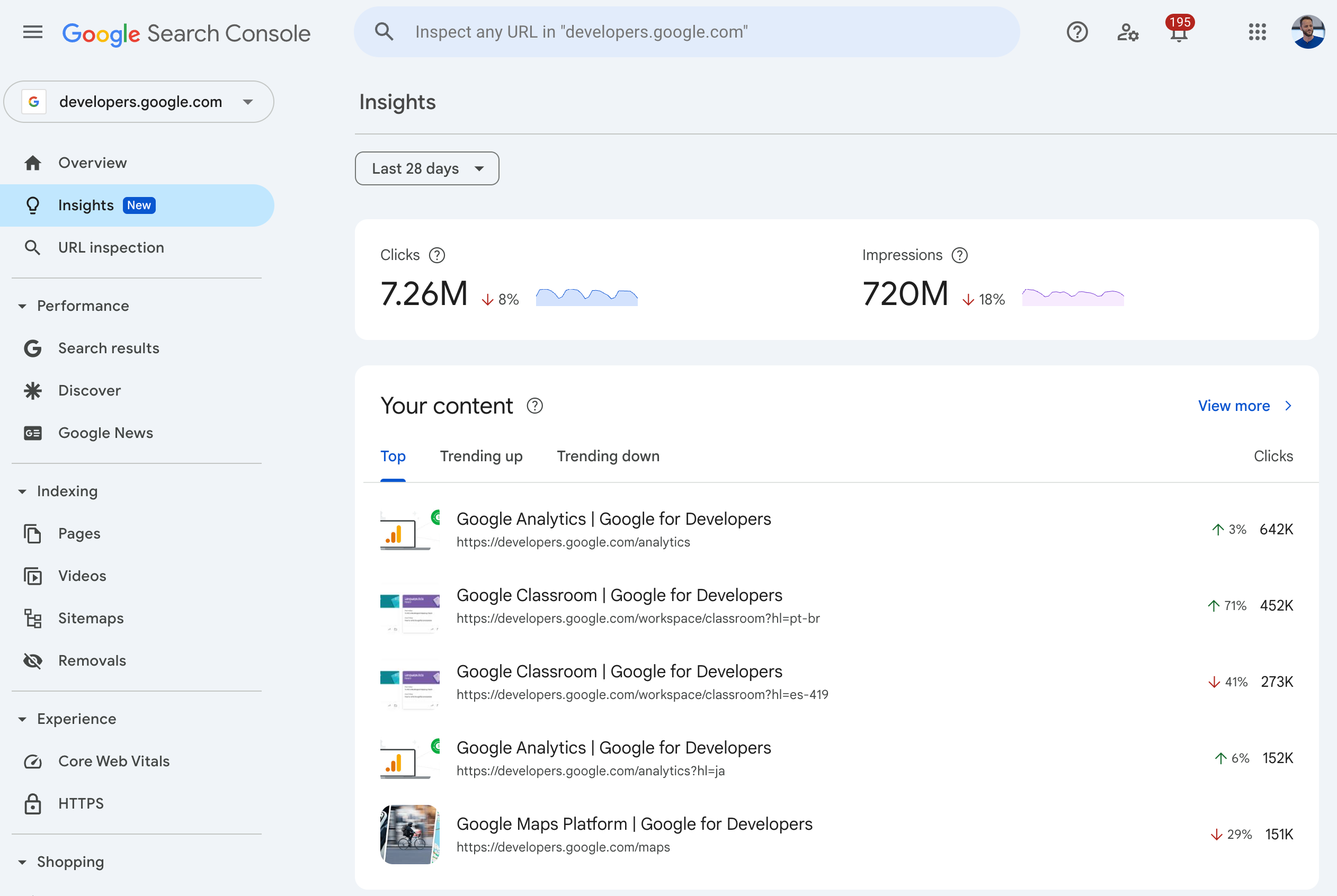

یادگیری تقویتی نوعی یادگیری ماشین است که در آن رباتها از طریق انتقاد و تشویق، یاد میگیرند. برنامههای زیادی در زمینههای رباتیک، گیمینگ و حتی بانکداری از این روش استفاده کردهاند. برای مثال، شرکت DeepMind در برنامه AlphaGo از این روش برای بهتر کردن گیمپلی خود و شکست دادن بازیکنان حرفهای بازی Go استفاده کرده است. این نشان میدهد که یادگیری تقویتی در تصمیمگیریهای پیچیده بسیار موثر است. توییت Miles Grimshaw نیز به همین پروژه اشاره میکند:

هوش مصنوعی میتواند عاملی برای پیشرفت ما باشد. جالبترین مطلبی که من در این مورد دیدهام، مقالهای است که عملکرد بازیکنان حرفهای بازی GO را قبل و بعد از معرفی Leela (نسخه متنباز AlphaGo) مقایسه میکند. با Leela، عملکرد بازیکنان بهتر شده است.

۵. یادگیری انتقالی (Transfer learning)

یادگیری انتقالی یکی دیگر از استراتژیهای یادگیری ماشین است که در آن از مدلهای آموزشدیده قدیمی برای حل مسائل کاملا جدید استفاده میشود. اهمیت این روش زمانی بیشتر میشود که اطلاعات زیادی درباره یک مشکل جدید وجود نداشته باشد. بهعنوان مثال، محققان از یادگیری انتقالی برای تطبیق انواع مختلف مدلهای تشخیص مثل مقایسه تصاویر چهره با تصاویر حیوانات استفاده میکنند.

به کمک یادگیری انتقالی میتوان از ویژگیها، ارتباطات و سوگیریهایی که در مدلهای قبل آموخته شده، مجددا در تسکهای جدید استفاده کرد. این باعث میشود که عملکرد مدل بهتر شود و حجم داده کمتری برای آموزش به مدل نیاز باشد.

نظرات کاربران